Les villes modernes doivent gérer simultanément le transport, l’approvisionnement en énergie, le logement, l’infrastructure, l’administration et l’adaptation au climat. Et ce, alors que la population augmente et que les ressources se raréfient. Les approches « smart city » considèrent la ville comme un écosystème dans lequel la mobilité, l’énergie, les bâtiments, le climat et la gouvernance sont interdépendants. Les capteurs, les espaces de données et les plateformes numériques créent de la transparence, fournissent des informations en temps réel et améliorent la base des décisions à long terme. Ce qui est décisif, ce n’est pas la numérisation de silos individuels, mais l’interaction des systèmes.

La Suisse dans le groupe de tête international

Dans l’IMD Smart City Index, Zurich occupe depuis des années une place de choix et se trouve à nouveau en tête du classement mondial en 2025. Genève et Lausanne se classent également dans le top 10, ce qui souligne la force de l’approche suisse avec une qualité de données élevée, une infrastructure bien développée et un environnement de recherche solide. Parallèlement, des villes de taille moyenne comme Saint-Gall, Winterthour ou Lugano développent leurs propres stratégies de villes intelligentes, plateformes de données et projets pilotes. Souvent en se concentrant sur la mobilité, l’administration et l’énergie.

Modèles internationaux et voies différentes

Singapour est considérée comme une référence en matière de stratégies numériques nationales intégrées, dans lesquelles la mobilité, l’énergie, l’administration et la santé sont reliées par des données et des plateformes. Copenhague combine les technologies de la smart city avec une politique de durabilité cohérente et une mobilité à faibles émissions, tandis qu’Helsinki marque des points avec des approches de données ouvertes étendues et une administration numérique. Des villes comme Dubaï, Londres ou Amsterdam mettent l’accent sur des aspects différents. Des grands programmes d’infrastructure à la gouvernance éthique des données en passant par la mobilité axée sur les données. Elles ont toutefois en commun une volonté politique claire et des stratégies à long terme.

Gouvernance, données et réalité fédérale

La smart city n’est qu’en partie une question technique. Sans espaces de données solides, sans compétences clarifiées, sans règles de protection des données et sans processus décisionnels transparents, les projets restent fragmentaires. Dans la Suisse fédérale, s’ajoute le fait que les communes, les villes, les cantons et la Confédération doivent coordonner leurs rôles. Pour de nombreuses communes, Smart City est donc avant tout synonyme de modernisation des processus, de collaboration interministérielle et de nouvelle conception du développement urbain. Les UrbanTech et PropTech relient ici l’administration, le secteur immobilier, les systèmes d’énergie et de mobilité. Plus ces systèmes sont étroitement couplés, plus le levier pour un développement urbain durable est important.

La technologie comme moyen, pas comme objectif

Les smart cities les plus performantes du monde ne se distinguent pas par le nombre de leurs capteurs, mais par leur gestion de la complexité. Elles utilisent la technologie de manière ciblée pour améliorer la qualité de vie, la résilience et l’efficacité. Elles intègrent des solutions numériques dans des objectifs sociaux et écologiques. La Smart City est donc moins un projet informatique qu’un projet de développement urbain dans lequel la technologie reste un outil. Ce qui est décisif, c’est la manière dont les villes prennent des décisions plus intelligentes, plus inclusives et plus durables à l’aide de données et de systèmes numériques.

Qu’est-ce qu’une Smart City exactement ?

Smart City – définition précise :

Une Smart City est une ville qui utilise les technologies numériques, les données et les systèmes en réseau pour améliorer la qualité de vie, la durabilité, l’efficacité et la participation. Elle intègre l’énergie, la mobilité, les bâtiments, l’administration et l’environnement dans un modèle commun de données et d’organisation et utilise ces informations pour gérer intelligemment les services, l’infrastructure et la planification urbaine.

Ce qui est décisif, ce n’est pas la technologie elle-même, mais la capacité à l’utiliser de manière responsable, sûre et ciblée, dans l’intérêt de l’ensemble de la population.

Les smart cities promettent efficacité, durabilité et de meilleurs services urbains. En même temps, elles comportent des risques qui doivent être soigneusement abordés. Les domaines suivants sont particulièrement critiques :

Protection des données et surveillance

Les capteurs, les caméras, les données de mobilité et les infrastructures en réseau génèrent d’énormes quantités de données sur le comportement, les mouvements et l’utilisation de la population. Sans règles claires, il peut en résulter un risque de surveillance, que ce soit par l’État ou le secteur privé.

Le pouvoir des algorithmes

Lorsque des systèmes basés sur des données dirigent des décisions, par exemple dans le domaine des transports, de l’administration ou de l’utilisation de l’énergie, le risque de processus opaques ou difficilement compréhensibles apparaît. Le manque d’explications ou des modèles invérifiables peuvent affaiblir la confiance de la population.

Contrôle démocratique

Les décisions relatives aux villes intelligentes se situent souvent à l’interface entre l’administration, les fournisseurs de technologies et les exploitants d’infrastructures. Les critiques mettent en garde contre le fait que les décisions importantes en matière de développement urbain pourraient être de plus en plus influencées par des systèmes techniques ou des entreprises privées.

Inégalités sociales

La numérisation est coûteuse. Les villes disposant de moins de ressources risquent de prendre du retard. Une « fracture numérique » peut également apparaître au sein d’une ville. Entre ceux qui peuvent utiliser tous les services et ceux qui en sont exclus. Que ce soit pour des raisons financières, techniques ou sociales.

Complexité et dépendance

Plus une ville est intelligente, plus elle est dépendante de systèmes numériques, de plateformes et de partenaires technologiques externes. Les pannes, les cyberattaques ou les défaillances techniques peuvent avoir des conséquences importantes sur l’infrastructure, la sécurité ou l’approvisionnement.

Absence de normes et de gouvernance

En l’absence de modèles de gouvernance clairs, des solutions isolées, des systèmes incompatibles et des responsabilités mal définies apparaissent. Cela peut réduire à néant les gains d’efficacité et compliquer les investissements à long terme.

Gadgets urbains intelligents internationaux qui ont fait les gros titres

Smart Lamp Posts, lampadaires connectés (Barcelone, Los Angeles, Londres)

Lampadaires intelligents équipés de capteurs pour le trafic, le bruit, la météo, la qualité de l’air et la détection des places de parking.

Ils ont fait sensation parce qu’ils sont déguisés en infrastructure inoffensive, mais collectent de grandes quantités de données.

– Symbole de la technologie « visible invisible » des villes intelligentes.

« Quayside Project » Sidewalk Labs Mâts à capteurs (Toronto)

Alphabet/Google a planifié un quartier avec un environnement entièrement sensoriel.

Température, mouvement, mobilité, déchets, énergie, tout devait être mesuré en temps réel.

– A été stoppé suite à des critiques sur la protection des données. Discuté dans le monde entier.

« Lampposts-as-a-Platform » (Singapour)

Singapour a équipé des lampadaires de caméras, de microphones et de modules IoT, en tant qu’infrastructure pour la conduite autonome et les systèmes de sécurité.

– Connu internationalement pour sa surveillance et son efficacité basées sur l’IA.

Smart Waste Bins, poubelles solaires (Bigbelly, New York, Berlin, Vienne)

Compacter les déchets, signaler les niveaux de remplissage et servir en partie de points d’accès WLAN.

– A fait la une des journaux parce que certains modèles pouvaient collecter secrètement des données (« WLAN Tracking »).

Parkings intelligents, parkings à capteurs (San Francisco, Amsterdam)

Des capteurs au sol signalent les places de parking libres en temps réel.

– Connu grâce au projet SFpark, qui a permis de réduire le trafic de manière mesurable.

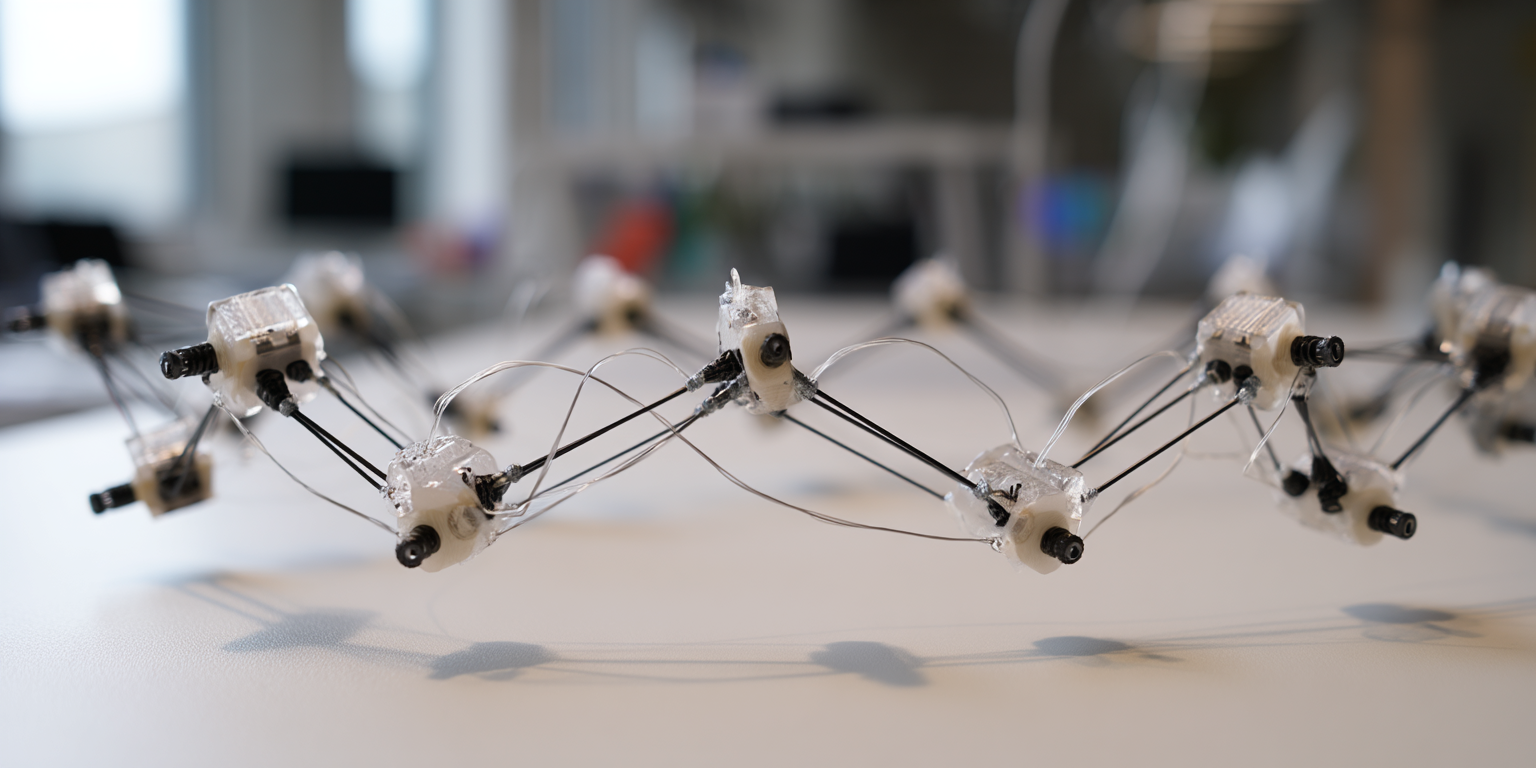

Autonomous Delivery Robots (Londres, Tallinn, San Francisco)

Robots transportant des denrées alimentaires et des colis.

– Médiatiques, car ils sont considérés comme de « nouveaux usagers de la route » sur les trottoirs.

Feux de circulation basés sur l’IA (Hangzhou, Tel Aviv, Los Angeles)

Les caméras et l’IA contrôlent les feux de circulation de manière dynamique, réduisant les temps d’embouteillage jusqu’à 30 %.

– Le système « City Brain » d’Alibaba à Hangzhou est particulièrement connu.

Programmes de drones pour le sauvetage et la logistique (Rwanda, Dubaï, Zurich)

Des drones livrent des médicaments, des défibrillateurs et du matériel médical.

– Connu pour Zipline (Rwanda) et la logistique médicale par drone en Suisse.

Smart Benches avec fonction de charge et capteurs (Prague, New York, Dubaï)

Des modules solaires chargent les smartphones, des capteurs intégrés mesurent les valeurs environnementales.

– Viral, car ils allient design, énergie et technologie.

Informations citoyennes holographiques et cartes AR (Séoul, Tokyo, Shanghai)

Écrans AR interactifs pour la navigation, la participation ou l’administration.

– Les premiers prototypes ont été célébrés lors de salons et partagés à l’échelle mondiale.

Sound Traffic Light, systèmes radars pour le bruit (Paris)

Des caméras et des microphones mesurent les véhicules trop bruyants et déclenchent automatiquement des amendes.

– Grand écho médiatique grâce au respect de la vie privée contre la lutte contre le bruit.

Police robotisée et véhicules de sécurité autonomes (Dubaï)

Dubaï a été l’une des premières villes à présenter des robots de surveillance de type « Robocop ».

– Sujet médiatique mondial, à la fois futuriste et controversé.

Top 20 Smart Cities 2025 – Classement international

1.Zurich (Suisse)

Combinaison supérieure de qualité de vie, de gestion numérique, de mobilité et d’efficacité énergétique.

2.Oslo (Norvège)

Leader en matière de protection du climat, de solutions de mobilité autonome et de gouvernance numérique.

3.Singapour (Singapour)

Smart Nation comme principe directeur de l’État, mobilité & administration totalement intégrées.

4.Genève (Suisse)

Gouvernance internationale, gestion intelligente de la mobilité, haute qualité de service urbain.

5.Copenhague (Danemark)

Leader mondial du développement urbain durable et de la planification de la mobilité en réseau.

6.Lausanne (Suisse)

Forte recherche (EPFL), planification urbaine innovante, espaces de données sur la mobilité et l’énergie.

7.Helsinki (Finlande)

Données ouvertes, administration numérique et normes de transparence parmi les plus élevées au monde.

8.Londres (Royaume-Uni)

Données de mobilité, zones pilotes d’IA, économie de partage et première scène mondiale de GovTech.

9.Abu Dhabi (EAU)

Numérisation massive de l’administration, mobilité intelligente & infrastructure automatisée.

10.Amsterdam (Pays-Bas)

Pionnier en matière d’éthique des données, d’économie circulaire et de projets de villes intelligentes axés sur les citoyens.

11.Stockholm (Suède)

Forte infrastructure IoT, efficacité énergétique, accès numérique aux services publics.

12.Séoul (Corée du Sud)

Gouvernance intelligente, systèmes de feux de signalisation à IA, infrastructure urbaine hautement connectée.

13.Dubaï (EAU)

L’une des villes les plus axées sur la technologie au monde : transport autonome, impression 3D, GovTech.

14.Vienne (Autriche)

Excellence administrative, smart living, innovation sociale et résilience urbaine.

15.Barcelone (Espagne)

Capteurs urbains, plates-formes de mobilité, mouvement Open Data et Civic Tech.

16.Prague (République tchèque)

Montée en puissance en Europe : mobilité intelligente, administration numérique, initiatives open data.

17.Tokyo (Japon)

Mobilité autonome, robotique, infrastructure intelligente à l’échelle d’une mégapole.

18.Tallinn (Estonie)

Champion du monde de l’e-gouvernement, administration basée sur la blockchain, identité numérique.

19.Canberra (Australie)

Administration numérique et systèmes de mobilité de très haut niveau.

20.Vancouver (Canada)

Urbanisme durable, mobilité intelligente, forte scène de la technologie et de l’innovation.